Pouvez-vous faire confiance aux aperçus de l'IA? Des études récentes suggèrent qu'ils peuvent ne pas être aussi précis que vous le pensez

Les aperçus de l'IA de Google promettent des réponses instantanées, mais de nouvelles recherches montrent qu'elles ne sont pas toujours fiables. Des affirmations généralisées sur les sources obsolètes, voici pourquoi vous devriez réfléchir à deux fois avant de faire confiance à ce petit résumé soigné en haut de vos résultats de recherche.

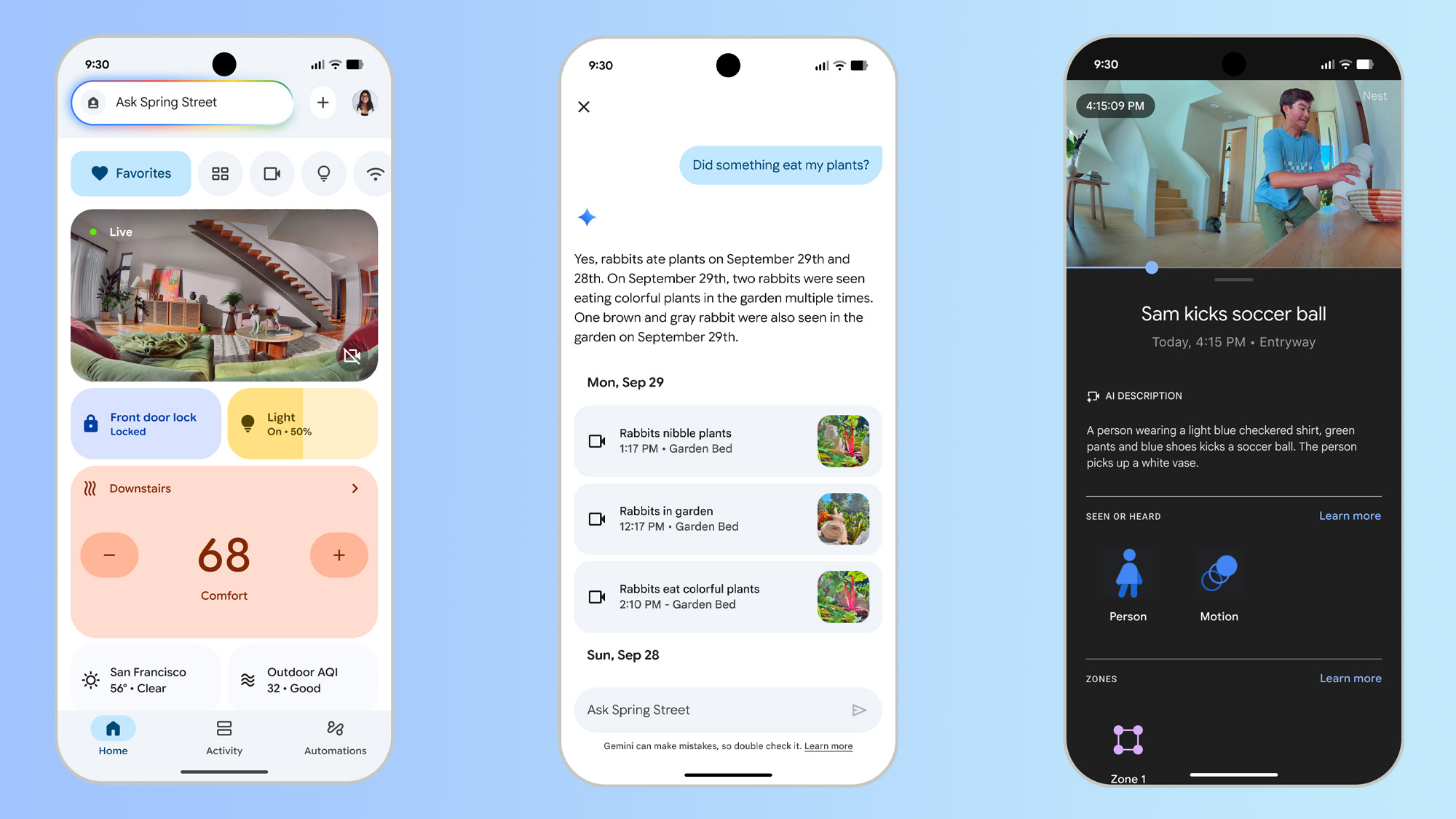

Après avoir déployé plus tôt cette année, ces aperçus de l'IA et apparaissent désormais de plus en plus en haut des résultats de la recherche. Au lieu de tirer un devis direct d'un site, Google utilise l'IA pour générer un bref résumé de ce qu'il pense être la meilleure réponse à votre question.

Par exemple, il pourrait même tirer cet article et le résumer pour vous. Et bien que cela puisse sembler pratique, il y a un gros problème avec la précision de ces aperçus. Des recherches récentes montrent que l'IA exagère et sert même des informations obsolètes et des gloses sur les détails les plus importants. Avec Chatgpt mal 25% du temps, cela vaut la peine de regarder de plus près comment nous obtenons des informations de l'IA.

Ce que montrent les études

L'IA est confiante, ce qui peut être un problème. Même si la réponse est mauvaise, l'IA met en évidence les informations et la rend automatiquement exacte, même si elle n'est pas toujours correcte.

Dans une étude évaluée par des pairs, les chercheurs ont testé des résumés de style Chatppt des résumés scientifiques. Sur le papier, les résultats semblaient bons: les résumés ont été jugés à 92,5% précis en moyenne. Semble assez bon, non? Mais même avec un score de précision élevée, les critiques ont noté que les détails clés étaient souvent laissés de côté. En d'autres termes, l'IA vous a donné l'essentiel, tout en laissant des aspects importants. Il a supprimé la nuance qu'un utilisateur aurait vraiment besoin de comprendre les vraies conclusions.

Un autre problème majeur avec les aperçus de l'IA est que la génération sur la génération est un problème récurrent. Lorsque des chercheurs d'une étude ont poussé des modèles à être précis, des modèles de gros langues ont souvent surestimé des conclusions. Entre 26% et 73% des résumés ont introduit des erreurs en exagérant les réclamations. Cela peut ne pas sembler catastrophique, mais lorsque des conclusions scientifiques prudentes sont transformées en déclarations audacieuses et simplifiées, les lecteurs peuvent repartir avec la mauvaise impression.

Google favorise le consensus – même si c'est mal

Un test a révélé un problème encore plus grand: l'aperçu de l'IA de Google a répété une réponse obsolète simplement parce que c'était la version la plus courante trouvée en ligne. J'ai personnellement remarqué cela et je trouve cela extrêmement frustrant. Même si une réponse plus récente et correcte est avilable, si elle n'est pas largement publiée, l'IA ne le montrera pas parce que l'IA s'appuie fortement sur le consensus, pas la précision, ce qui signifie que si les informations sont populaires, elle apparaîtra – même s'il n'est pas exact.

L'échelle est une autre préoccupation. Un audit massif de plus de 400 000 aperçus d'IA a révélé que 77% d'entre eux ne citent des sources que des 10 premiers résultats organiques. Cela peut sembler efficace, mais cela crée une chambre d'écho. Si aucune de ces pages les mieux classées n'est courante ou précise, le résumé de l'IA ne le sera pas non plus.

Le détail le plus révélateur des aperçus de l'IA est probablement le fait que même Google n'est pas pleinement confiant dans la capacité d'une IA. La société indique que les aperçus de l'IA se déroulent «au pair» avec ses extraits traditionnels en vedette, mais il comprend toujours un avertissement: «Les résultats peuvent ne pas être exacts». Cela devrait vous dire tout ce que vous devez savoir.

Pourquoi les aperçus de l'IA se trompent

Il y a quelques raisons récurrentes que ces résumés manquent la marque. Les hallucinations sont les plus évidentes. Ces erreurs sont des moments où l'IA invente simplement un détail pour combler une lacune. Les sources obsolètes sont un autre coupable. Si les articles les plus visibles sont anciens ou défectueux, l'IA ne sait pas mieux; Cela les répète.

Il y a aussi la question du biais vers la répétition. L'IA s'appuie sur les modèles et le consensus, ce qui signifie que les réponses populaires sont amplifiées, qu'elles soient correctes ou non. Et enfin, il y a le problème de manquer complètement le contexte. Les réponses compliquées sont souvent poncées dans quelque chose de court et de confiance, mais cette brièveté peut effacer un contexte important.